En ny deepfake-applikasjon går dypere enn “vanlig” hevnporno. Selv om resultatene fremdeles ikke er perfekt, er konsekvensene for kvinner ødeleggende.

Gjør hvem som helst til pornostjerne ved å deepfake personens ansikt inn i en voksenvideo

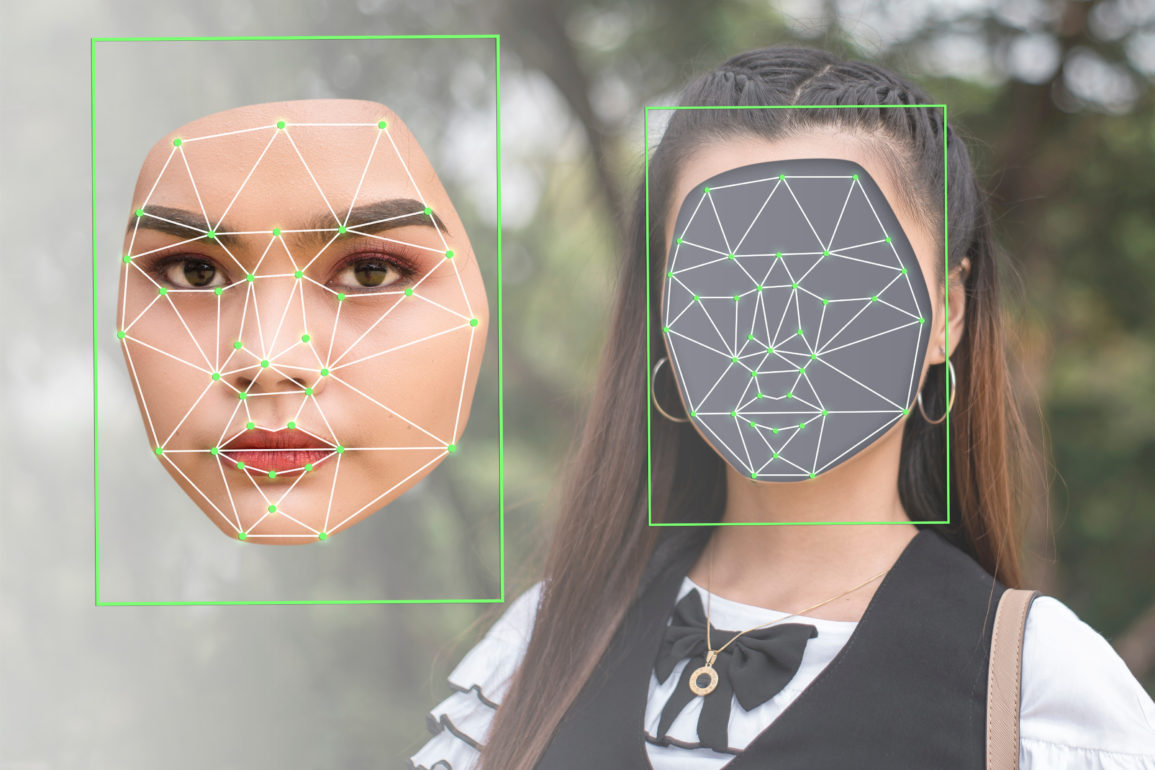

Deepfake-nettstedet imponerer med sin enkelhet: En hvit bakgrunn med en stor blå knapp hvor brukeren kan laste opp et bilde av et ansikt. Under knappen kan tjenesten testes med fire AI-genererte ansikter. Overskriften er: “Gjør hvem som helst til pornostjerne ved å sette personens ansikt inn i en voksenvideo ved hjelp av deepfake-teknologi.” Alt du trenger er bildet og et klikk på knappen.

Vi bruker “XX” som pseudonym på tjenesten som ble oppdaget av deepfake-forskeren Henry Ajder.

Krysser nye etiske grenser

Så langt har XX en relativt liten, men ganske aktiv brukerbase som gir tilbakemeldinger til utvikleren i online-fora. Forskeren hadde fryktet at en slik app skulle dukke opp og denne krysser en etisk grense som ingen andre tjenester har overskredet før.

Annonse

90 prosent rammer kvinner

AI-genererte syntetiske medier er blitt brukt til å lage pornografiske skildringer av kvinner og det kan ha alvorlige psykologiske konsekvenser for dem som rammes. Den opprinnelige Reddit-skaperen populariserte teknologien ved å sette inn ansikter til kvinnelige kjendiser i pornovideoer. Forskningsfirmaet Sensity AI anslår at mellom 90 og 95 prosent av alle pornografiske deepfake-videoer på internett til dags dato er porno uten samtykke, og 90 prosent av disse viser kvinner.

Verktøy som “kler av” kvinnekropper

Ettersom teknologien har utviklet seg har det dukket opp brukervennlig verktøy som kan “kle av” kvinnekropper. Mange av disse tjenestene er blitt tatt ned, men koden er open source og dukker opp i stadig i nye former. Det sist oppdagede web-sted for forfalsket porno hadde over 6,7 millioner besøk. Det er fremdeles online.

Skreddersydd for pornografi

Det eksisterer flere ansiktsbytte-apper som ZAO og ReFace som setter brukerne i scener fra vanlige filmer eller popvideoer. “DeepNude” “kler av” kvinner ved å erstatte klærne med en datagenerert naken kvinnekropp. Den pornografiske ansiktsbytte-appen XX går et skritt videre. Den er “skreddersydd” for å lage pornografiske bilder av mennesker uten deres samtykke, sier Adam Dodge, grunnlegger av EndTAB, en ideell organisasjon som driver opplysningsvirksomhet om teknologibaserte overgrep.

Kvaliteten spiller mindre rolle

XX er enkel å bruke. Når du laster opp et ansikt åpner nettstedet et porno-bibliotek, mest av kvinner, men også en håndfull menn for homoporno. Brukeren kan velge hvilken som helst video og forhåndsvisning kommer i løpet av få sekunder. Om du ønsker å laste ned filmen må du betale.

Resultatene er langtfra perfekt. Mange ansikter er åpenbart forfalsket ettersom de forvrenges når de roteres. For en tilfeldig observatør er forvrengningen subtil nok til å kunne overses – spesielt om oppmerksomheten er rettet mot andre detaljer.

“Redskap for utforskning av seksuelle fantasier”

Psykologer hevder også at kvaliteten på deepfake spiller en underordnet rolle da den psykiske skade for ofrene vil være like stor uansett. I tillegg er mange mennesker fremdeles uvitende om at denne teknologien eksisterer, og det kan få dem til å tro at det hele skyldes vanskelige opptaksvilkår eller dårlig filmkvalitet.

XX fremstiller seg selv som et trygt og ansvarlig redskap for utforskning av seksuelle fantasier, og oppfordrer brukerne til å laste opp sitt eget ansikt. Men ingenting hindrer dem i å laste opp andres, og kommentarene på nettfora tyder på at det er nettopp det brukerne gjør.

Like sårende som hevnporno

Konsekvensene for målrettede kvinner kan være ødeleggende. På et psykologisk plan kan disse videoene føles like sårende som såkalt hevnporno – altså ekte intimvideoer filmet eller spredd uten samtykke.

Denne typen overgrep – at folk gir en uriktig fremstilling av din identitet, ditt navn og ditt omdømme og endrer det på en så sårende måte – ryster deg i grunnvollene.

Noelle Martin, australsk aktivist og deepfake pornooffer

Effektene kan følge ofrene hele livet igjennom. Bildene og videoene er vanskelig å fjerne fra nettet og nytt materiale kan når som helst skapes.

Det påvirker mellommenneskelige relasjoner; det påvirker jobben, det påvirker ansettelsesprosedyrer. Filmen eller bildene kan dukke opp som tema i hvert intervju du går til. Det påvirker potensielle romanser. Jeg har aldri lykkes i å fjerne bildene helt. De vil alltid være der uansett hva jeg gjør.

Noelle Martin

Deepfake-porno kan få økonomiske og profesjonelle konsekvenser. Rana Ayyub, en indisk journalist som ble utsatt for deepfake-porno, ble så sterkt trakassert at hun måtte minimere den offentlige profilen hun trengte i arbeidet sitt.

“Flere og flere kvinner angrepet”

Den offentlig finansierte britiske Revenge Porn Helpline mottok nylig en sak om en lærer som mistet jobben da skolen ble gjort oppmerksom på falske pornobilder av henne på sosiale medier.

Det blir verre, ikke bedre. Flere og flere kvinner blir angrepet på denne måten.

Adam Dodge, grunnlegger av EndTAB

XXs evne til å produsere deepfake homoporno er begrenset, men det utgjør en spesiell trussel mot menn i de 71 land i verden som har kriminalisert homofili. Elleve av disse landene straffer avvikende seksuell legning med døden, og sannsynligvis er det tolvte landet, Afghanistan, på vei inn i den gruppen.

Forbudslinje?

Ajder har oppdaget en rekke deepfake pornoapper de siste årene. Han har prøvd å kontakte XXs vertstjeneste og presse dem til å lukke tjenesten, men han ser pessimistisk på utviklingen. Enda et nettsted er dukket opp og ser ut til å prøve det samme. Etter hans mening er en mulig løsning å forby slikt innhold og kanskje også forby å opprette eller bruke slike tjenester.

Det betyr i tilfelle at slike nettsteder blir behandlet på samme måte som materiale på det mørke nettet. Om det blir kjørt under jorden vil det i det minste forsvinne fra normale menneskers øyne.

Henry Ajder, deepfake-forsker

WHOIS-informasjon knyttet til domenet XX er skjult av “personvernhensyn”.

Annonse