Det er alltid snakk om “skyen” når Microsoft snakker om seg selv – alt Microsoft gjør har noe med Azure-skyen å gjøre.

Det nye i år er at døra er litt mer på gløtt i forhold til hvordan vi tror den digitale fremtiden vår blir med AI, for AI-utvikling har eksplodert og utviklerne får nå AI-verktøy servert over nettet fra nettopp Azure. Vi er inne i en spennende tid der utviklere på sekundet kan kalle fram en AI fra skyen. Det er nærmest umulig å spå hvor dette vil gå.

Nå vet du hva du skal svare om noen spør

Jeg må innrømme jeg ikke hadde peiling på hva “edge” betydde før etter Microsofts tre timer lange keynote i dag.

La meg derfor få det unna og oppsummere kort og enkelt hva “edge” er: lokal AI-prosessering – være det seg i en drone som kan se et ødelagt rør, en mobil med en assistent og smart mobil-kamera som vet hva den ser eller en smart-høyttaler som ikke er avhengig av Internett hele tiden.

Annonse

Poenget er å kutte ned responstiden og gjøre enhetene morsommere og mer praktiske i bruk. Årsaken til at mobilen din tar så gode bilder, er mye grunnet dette.

Vi satte oss ned for en samtale med Microsofts Dave Forstrom mellom slagene her på Build. Forstrom har den flotte tittelen “Senior Director of Comms, Artificial Intelligence and Research group”.

Mannen vet med andre ord mye om hva hvor Microsoft skal gjøre fremover, og hva de gjør i dag. Vi prøver å gi deg et overblikk i denne artikkelen, samtidig som vi håper og tror at den avanserte AI-forskningen Microsoft driver med nå, kan komme til oss i en lekker eske med et spennende nytt forbrukerprodukt i… en eller annen gang.

Men først, litt historie for å sette dette i perspektiv

Forstrom:- Microsoft har alltid vært et plattform-selskap. Gates sin visjon var at alle i verden skulle ha en PC hjemme. Senere, med Microsoft Research, utvidet Gates visjonen med tale og syn. Altså datamaskiner som kan lære å forstå verden. Det var i 1991, men det var ikke før de siste tre årene at AI har eksplodert.

– For to år siden klarte maskiner å gjenkjenne bilder like bra som mennesker, noe vi var først med. Og nå kan de også snakke og lese, det er et mål vi nådde i januar. Vi var først der også, så du ser hvor fort dette plutselig har akselerert.

Forstrom stresset Nadellas budskap til utviklerne:

– Vi er nødt til å flytte AI fra hendene til noen få eksperter og forskere, til alle utviklere og på den måten alle forbrukere, og dette går utrolig fort. Vi startet jo med tre kognitive funksjoner (lese, tale, syn) – nå har vi 30. En av de nyeste er “custom vision” som kan se objekter i bilder, eller bilder i bilder om du vil. Med “custom vision” kan vi trene maskinen å lære å se objekter i bilder. Dette er viktig blant annet for en drone som må analysere en videostrøm der det kan være feil med en rørledning. Slike ting.

Forstrom nevner også “unified speech service” som inkluderer tekst til tale, og andre veien, samt oversettelser. Han ga eksempler som at store sentralbord vil kunne lagre tale i tekst helt automatisk, og på den måten slippe å manuelt organisere og skjønne tusenvis av samtalelogger.

Vi ser for oss at selskap vil kunne yte kjappere service om de enklere vet hva vi ønsker svar og hjelp med, før vi spør.

Hvor ble det egentlig av bot-ene? De lever visstnok

Satya Nadella snakket masse om bot-er for et par år siden. Du har helt sikkert møtt dem i en nettbutikk eller når du trenger hjelp med nett-tilkoblingen, mobilen eller hva som helst. Først svarer bot-en deg, om den er for dum til å hjelpe deg, setter de deg over til et ekte menneske. Hei, det er penger å spare, må vite.

Vi har ikke hørt noe særlig om disse snakke-robotene etter Nadella og Zuckerberg snakket dem opp for noen år siden, men Forstrom ønsket å forsikre oss om at de lever i beste velgående, selv om Nadella ikke nevnte dem noe særlig under gårsdagens “keynote”.

Forstrom: – Bots er de nye appene. Over 300 000 utviklere bruker bot-tjenester og bot-ene har nå kognitive muligheter, blant annet at de lærer å ha en samtale med deg. Forskjellen er at vi nå kan lære dem å ha en samtale mer naturlig ved å bruke Azure.

– Det nyeste er Project Personality der vi har skapt tre chatbot-personligheter: en av dem er nøytral, en annen humoristisk og den siste oppfører seg proft som en kundebehandler skal. Slik kan bot-er brukes til å bli mer naturlige i forhold til hva bedriften ønsker å formidle utad og hvordan selskapet ønsker å gro egen kultur innad.

Microsoft Cortana og Amazon Alexa skal samarbeide – smelter sammen mobil og Windows

– Kan ikke du avsløre et nytt Microsoft forbruker-produkt som bruker “edge”, Dave?

Vi bare måtte fiske, og fikk selvsagt ingen avsløringer, men det han ikke svarte var likevel interessant. Forstrom er redd for å spå fremtiden som alle andre, spesielt innen AI, men det er tydelig at vi er på vei dithen at smarthøyttalere med Cortana og Alexa edge-mulighet der AI-en er lokal, og derfor vil svare deg kjappere. Det samme gjelder selvsagt for mobiler.

Mobiler ja. Hva i all verden driver Microsoft med når det kommer til mobiler? Ingen vet, utover alt de gjør med programvare på andres plattformer (Android, og nå også iOS), men Forstrom fisket flere ganger opp mobilen sin og spurte oss retorisk “hvordan i all verden vil formfaktoren på en mobil se ut om tre til fem år?”.

Det var da vi kom til å tenke på patent-lekkasjene fra Microsoft der selskapet pønsker på hvordan de kan lage en mobil med en skjerm som kan vippes ut og nærmest gi en nettbrett-lignende opplevelse. Surface Phone er selvsagt maskinvare-produktet alle Microsoft-fans venter på og håper de skal vise frem.

Eller tenk på det slik: er Microsofts trojanske hest-strategi ved å lure seg inn hos Android med egen hjemskjerm, en måte å gjøre oss vant til det kommende grensesnittet på en Surface Phone? Og, er brukerne av Microsoft Launcher med i et stort forskningsprosjekt der Microsoft prøver å finne ut hvordan de best kan skape et grensesnitt på egen mobil? Jeg drømmer, men det må da være lov.

Vi vet ikke noe mer enn at Microsoft garantert forsker på en rekke mobil-formfaktorer for fremtiden (det vil være viktig uansett om de ender opp med å lansere et butikkprodukt, om ikke for annet enn å vite hva som er mulig), og at det vil være viktig for dem at en slik enhet kan gjøre AI-oppgaver lokalt.

Ja, kanskje er det nettopp det de venter på. Altså at de riktige AI-brikkene kan masseproduseres? – Slikt er jo dyrt, hintet Forstrom.

Microsoft ønsker å forandre alt med Microsoft 365 og AI i skyen

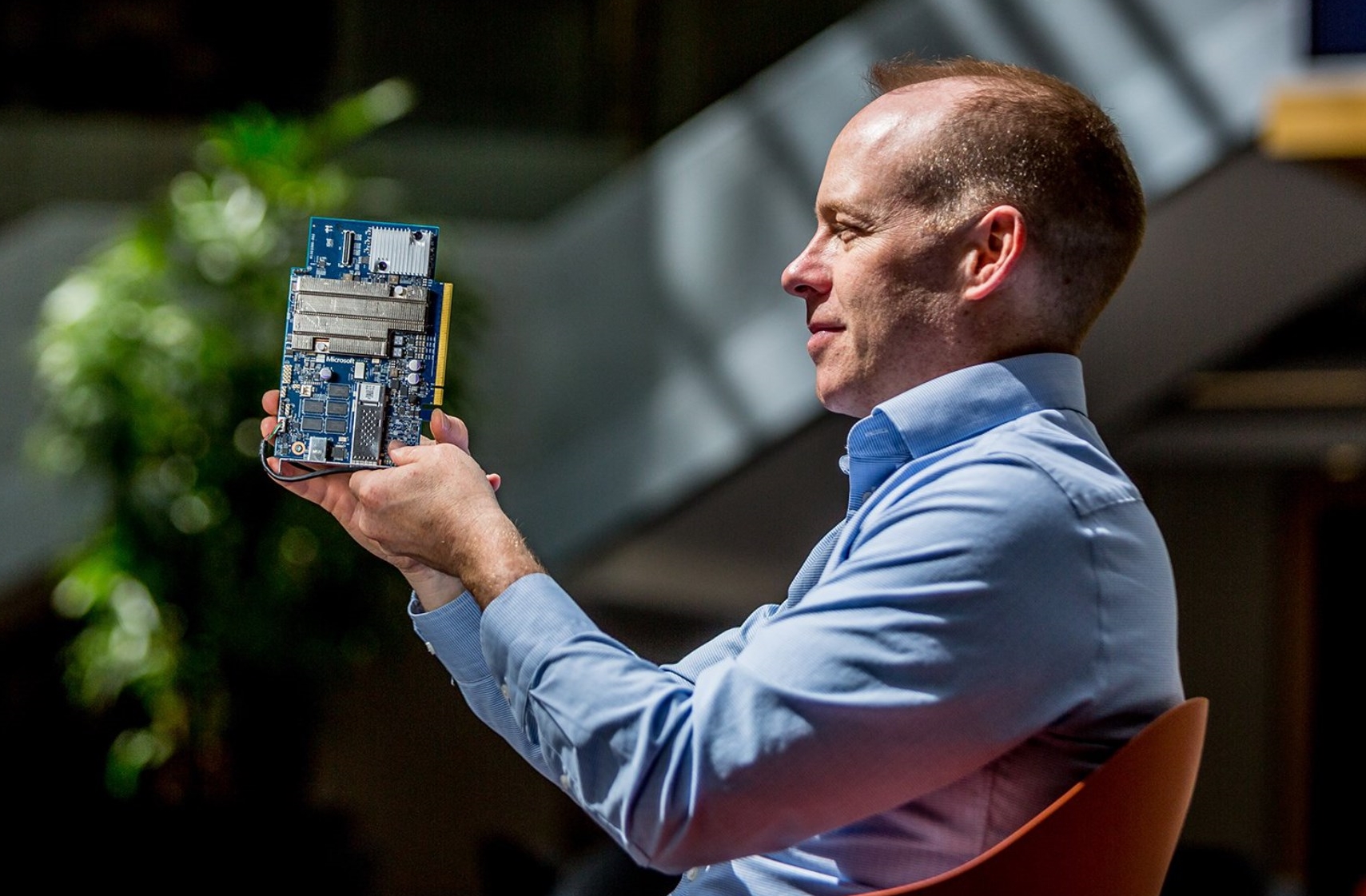

Project Brainwave og FPGAs

Project Brainwave er selskapets forsøk på å akselerere AI-hastigheter. De samarbeider med Intel om maskinvaren som er et FGPA (Field-programmable Gate Array).

FPGA har den store fordelen at de er relativt billige, men ifølge Microsoft har bransjens kjappeste svartid. Det er viktig når du ønsker svar fra AI-en du bruker.

Et annen viktig poeng med FPGA er at de kan programmeres og endres på etter at de er produsert, og derfor fungerer mer som hjernen vår, enn et statisk CPU eller GPU som ikke kan endres etter at spesifikasjonene er spikret.

Forstrom ville ikke gå så langt og si at FPGA kommer til mobiler eller noe slikt, men han er helt klar på at “edge AI” er noe som vil komme til mobiler. Vi vet at Amazon jobber med slik maskinvare, og nå som Microsoft samarbeider med dem, vil de kunne bruke denne kunnskapen i kommende produkter.

Annonse